Wie Wissenschaftler untersucht haben kann das auch zu Diskriminierung führen. Das vor allem, wenn es um Werbung für Jobs oder Wohnung geht. Es geht nicht nur um das Ausfiltern, auch die Art der Werbung wird heute auf die Demographie angepasst.

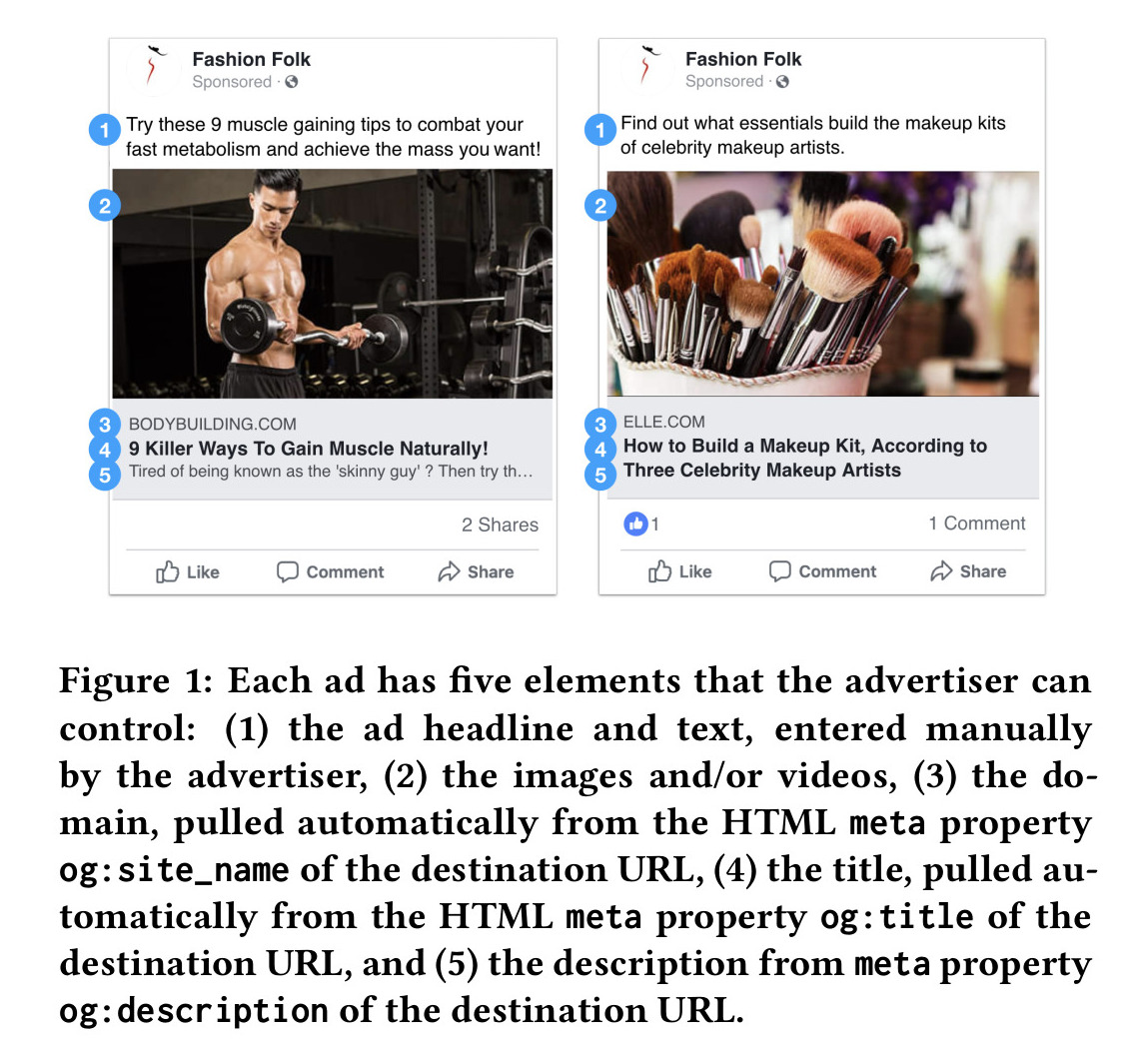

Der Werber kann Parameter anpassen. Titel und Text, Bild, und auch Meta daten, wie Titel, oder der Domain Name. Frauen oder Männer sehen verschiedene Varianten der Werbung.

Vom Artikel:

Womit wir wieder einmal bei Facebook und Google

wären. Diese Woche wurde eine Studie veröffentlicht, die

zeigt, wie Facebooks Systeme zur Verteilung von Werbung automatisch

Stereotype bedienen. Stellenangebote für Holzfällerjobs

wurden überwiegend weissen Männern gezeigt, Taxifahrerjobs

überwiegend schwarzen Nutzerinnen und Nutzern, Stellen an

der Supermarktkasse überwiegend Frauen. Obwohl die Forscher

von zwei US-Universitäten, die die Anzeigen selbst geschaltet

hatten, keinerlei Angaben zur gewünschten Zielgruppe gemacht

hatten. Facebooks Anzeigensystem entscheidet also autonom, wer am ehesten

für welche Jobs infrage kommt.

Geradezu gruselig mutet ein zweites Ergebnis an, eines mit für

Menschen unsichtbaren Bildern: Dafür haben die Forscher Anzeigen per

Bildbearbeitung so verändert, dass dem menschlichen Auge nur weisse

Flächen angezeigt werden. Für eine Bilderkennungssoftware waren

auf den Flächen jedoch Fotos zu erkennen. Entweder von stereotyp

"männlichen" Themen - Football, Kampfsport. Oder von stereotyp

"weiblichen" Themen - Modefoto, Rose.

Prompt zeigte Facebook die Anzeigen mit "männlichen" Bildern

überwiegend Männern, die mit "weiblichen" überwiegend

Frauen. Anders als wir Menschen kann die Software, die für Facebook

Bilder in Anzeigen analysiert, die Rose sehen - und entscheidet dann

offenbar, dass das jetzt aber mal eher ein Bild für Frauen ist. Auch

wenn die Frauen dann gar nichts sehen.

Es nicht schwierig zu erraten, wie diese Verzerrungen zustande kommen.

Facebooks Werbemaschinerie ist ein lernendes System. Es schliesst aus

den Daten, die es in der Vergangenheit gesammelt hat, auf das, was in

der Zukunft geschehen wird. Konkret: Wenn mehr Frauen auf Stellenanzeigen

für Jobs an der Supermarktkasse geklickt haben, bekommen in Zukunft

mehr Frauen solche Anzeigen zu sehen. Wenn Frauen öfter auf Rosen

klicken, zeigt man ihnen auch die unsichtbare Rose.

Das bringt zwei Probleme mit sich. Erstens könnte es sein,

dass diese Praxis zumindest in den USA illegal ist: Dort gab es

noch in den Siebzigerjahren Stellenanzeigen, die sich explizit nur an

Männer oder Frauen wandten. Längst gilt so etwas als illegale

Diskriminierung. Wegen ähnlich gelagerter Fälle hat Facebook

in den USA gerade Ärger mit Behörden und Gerichten.

Zweitens: Solche lernenden Systeme perpetuieren Stereotype. Die

Grundannahme ist immer die gleiche: Was in der Vergangenheit funktioniert

hat, wird auch in Zukunft funktionieren. Schwarze werden weiterhin

Taxifahrer, weisse Männer bestimmt Holzfäller oder - auch das

kommt in der Studie vor - Forscher im Bereich künstliche Intelligenz.